Qwen 3.5 là gì? Khám phá kiến trúc và cách tích hợp APIT

Trong cuộc đua trí tuệ nhân tạo toàn cầu, sự xuất hiện của các siêu mô hình Qwen 3.5 mô hình ngôn ngữ lớn (LLM) mã nguồn mở đang liên tục định hình lại giới hạn của công nghệ.

Mới đây nhất, sự ra mắt đầy ấn tượng của Qwen 3.5 từ Alibaba Cloud đã thực sự tạo nên một cơn địa chấn lớn trong cộng đồng lập trình viên. Hãy cùng mình giải mã chi tiết về sức mạnh cốt lõi, khả năng xử lý đa phương thức và hướng dẫn tích hợp API chuẩn xác nhất ngay trong bài viết dưới đây!

Qwen 3.5 là gì?

Qwen 3.5 đang là từ khóa công nghệ thu hút sự chú ý của toàn cầu và Sforum sẽ giúp bạn giải mã chi tiết sức mạnh của nó. Trả lời trực tiếp cho câu hỏi này: Đây là thế hệ mô hình ngôn ngữ lớn (LLM) đa phương thức, mã nguồn mở tiên tiến bậc nhất do Alibaba Cloud phát triển và chính thức ra mắt vào tháng 2/2026.

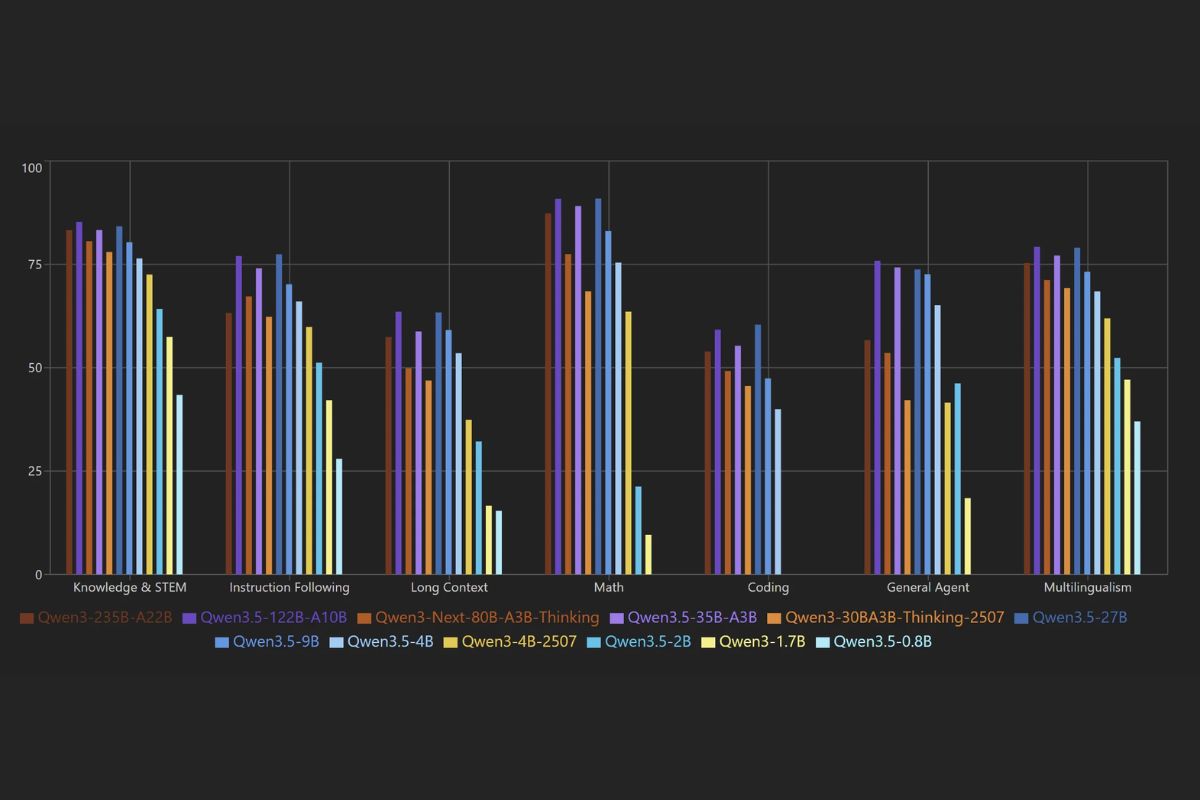

Phiên bản cao cấp nhất của series này mang tên Qwen3.5-397B-A17B, được vận hành dựa trên kiến trúc MoE (Mixture-of-Experts) thưa thớt với 397 tỷ tham số khổng lồ. Tuy nhiên, điểm làm nên sự khác biệt là hệ thống chỉ kích hoạt đúng 17 tỷ tham số chuyên biệt cho mỗi token xử lý. Điều này không chỉ mang lại khả năng phân tích, suy luận và lập trình xuất sắc mà còn giúp tối ưu chi phí cực thấp, đồng thời đẩy thông lượng lên cao gấp 8 lần so với thế hệ tiền nhiệm.

- Nhà phát triển: Alibaba Cloud.

- Cấu trúc lõi: Dựa trên kiến trúc MoE thưa thớt (Sparse Mixture-of-Experts).

- Thông số kỹ thuật: Tổng cộng 397 tỷ tham số (nhưng chỉ kích hoạt 17 tỷ tham số/token nhằm tối đa hóa hiệu suất).

- Cửa sổ ngữ cảnh: Hỗ trợ xử lý siêu lớn lên đến 1 triệu token (trên phiên bản đám mây Qwen3.5-Plus).

- Tính năng cốt lõi: Ghi dấu ấn với khả năng xử lý đa phương thức (văn bản, hình ảnh, video), giao tiếp 201 ngôn ngữ và được cấp phép mở chuẩn Apache 2.0.

Qwen 3.5 có những điểm gì nổi bật?

Mô hình AI của Alibaba được trang bị những đặc điểm kỹ thuật mang tính đột phá, tạo nên vị thế dẫn đầu trong giới công nghệ trí tuệ nhân tạo. Hãy cùng điểm qua ba nâng cấp đáng chú ý nhất dưới đây.

Kiến trúc MoE thưa thớt đột phá

Công nghệ lõi của hệ thống dựa trên kiến trúc MoE (Mixture of Experts - Hỗn hợp chuyên gia). Trong tổng số 397 tỷ tham số, mô hình chỉ chọn lọc và kích hoạt 17 tỷ chuyên gia phù hợp nhất cho mỗi lượt xử lý dữ liệu. Phương pháp thông minh này giúp hệ thống đạt được trí thông minh tương đương với một mạng nơ-ron khổng lồ, nhưng lại tiêu tốn cực ít bộ nhớ RAM và tài nguyên phần cứng.

Khả năng xử lý đa phương thức toàn diện

Thay vì sử dụng bộ chuyển đổi thị giác gắn ngoài như các hệ thống cũ, nền tảng này đưa trực tiếp các bản vá hình ảnh vào thẳng các lớp transformer từ giai đoạn huấn luyện đầu tiên (kỹ thuật hợp nhất sớm). Nhờ khả năng xử lý đa phương thức liền mạch này, AI có thể đọc hiểu ảnh độ phân giải cao 1344x1344px, quét video dài 60 giây và nhận diện giao diện người dùng (UI) chính xác đến từng pixel nhỏ nhất.

Cửa sổ ngữ cảnh siêu lớn

Đối với bản Qwen3.5-Plus trên đám mây, cửa sổ ngữ cảnh đã được mở rộng lên tới 1 triệu token. Sức chứa khổng lồ này cho phép AI phân tích trọn vẹn một kho lưu trữ mã nguồn lớn, xem bản ghi hình dài nhiều giờ hoặc phân tích tài liệu PDF 500 trang chỉ trong một câu lệnh (prompt) duy nhất mà không gặp phải hiện tượng "mất trí nhớ" ngữ cảnh.

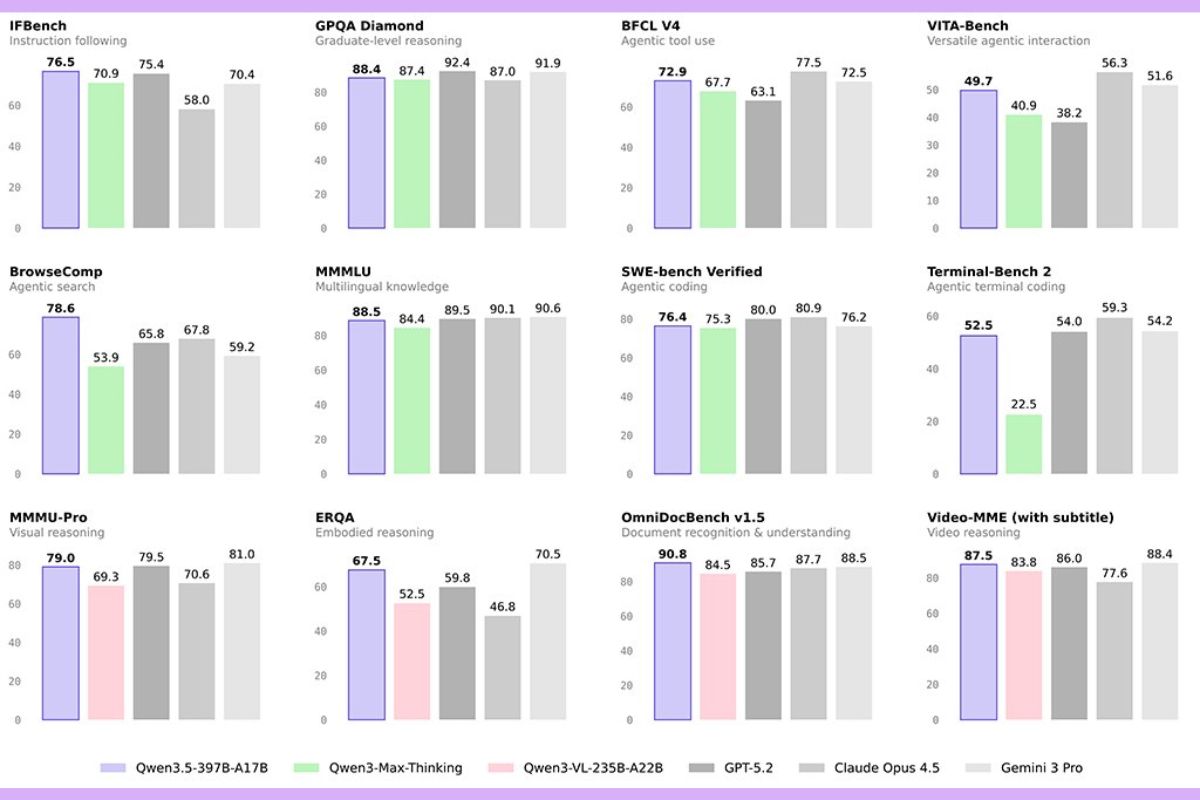

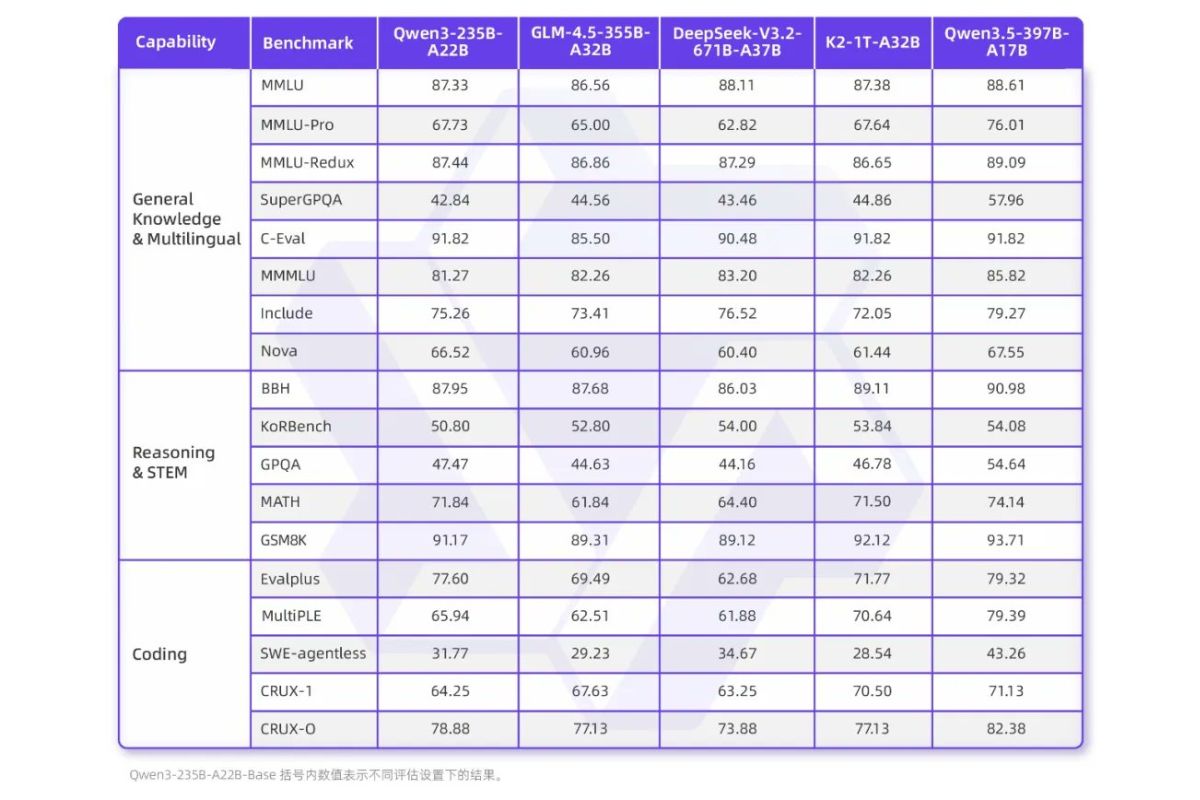

Điểm benchmark của Qwen 3.5 so với các đối thủ như thế nào?

Để thấy rõ sức mạnh thực sự của mô hình AI của Alibaba, chúng ta cần nhìn vào các bài kiểm tra hiệu năng độc lập.

| Mô hình | Đặc điểm Benchmark | So sánh chi phí |

| Qwen 3.5 | Đạt điểm benchmark vượt qua GPT-5.2, Claude 4.5 Opus ở 80% hạng mục đánh giá. Mức độ lập trình thi đấu (LiveCodeBench 83.6), giải Toán cấp độ Olympic (AIME 91.3). | Thấp hơn 60% so với phiên bản tiền nhiệm (Chỉ tốn khoảng 0.18 USD cho 1 triệu token). |

| Các đối thủ (GPT, Claude) | Yêu cầu tài nguyên máy chủ rất lớn, cửa sổ ngữ cảnh thường bị giới hạn trong khoảng từ 128k - 200k token. | Chi phí duy trì hệ thống và gọi lệnh API đắt đỏ hơn đáng kể khi dùng thực tế. |

Các ứng dụng thực tế của Qwen 3.5 mang lại giá trị gì?

Từ những thông số ấn tượng trên, nền tảng AI này đang được áp dụng mạnh mẽ để giải quyết các bài toán thực tiễn phức tạp:

- Phát triển phần mềm: Hỗ trợ lập trình viên tự động tái cấu trúc (refactor), viết code mới và gỡ lỗi toàn bộ kho lưu trữ mã nguồn lớn một cách chuẩn xác.

- Lĩnh vực tài chính: Nhanh chóng trích xuất các bảng biểu, đối chiếu dữ liệu và tóm tắt những báo cáo tài chính dài hàng trăm trang chỉ trong vỏn vẹn 30 giây.

- Y tế và chăm sóc sức khỏe: Tận dụng khả năng xử lý đa phương thức để hỗ trợ bác sĩ chẩn đoán bệnh thông qua ảnh chụp X-quang kết hợp với hồ sơ bệnh án.

- Thương mại điện tử: Tự động hóa khâu viết mô tả sản phẩm chuẩn SEO (hỗ trợ 201 ngôn ngữ), đồng thời gợi ý các gói bán kèm chuẩn xác dựa trên việc phân tích hình ảnh.

Hướng dẫn tích hợp API Qwen 3.5 cho lập trình viên ra sao?

Quá trình tích hợp API của nền tảng này vào cấu trúc hệ thống của bạn vô cùng trực quan và có thể hoàn thành nhanh chóng qua 4 bước cơ bản sau:

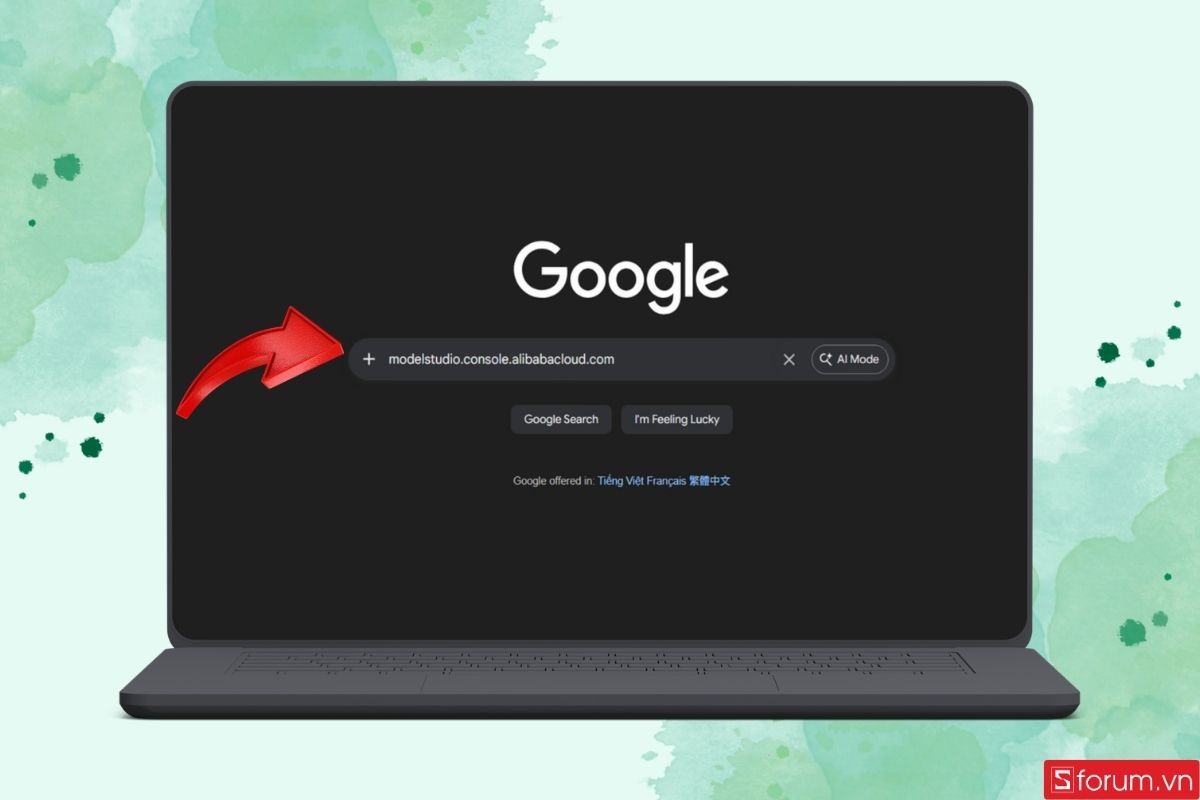

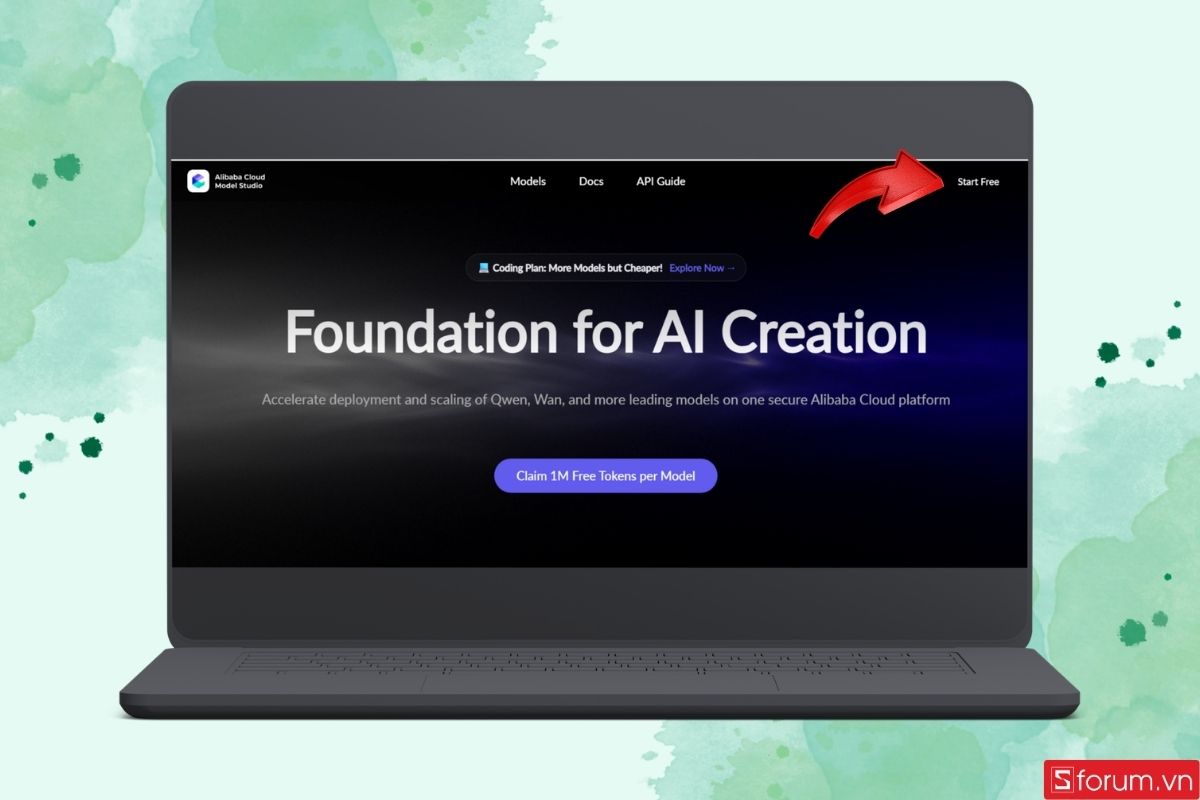

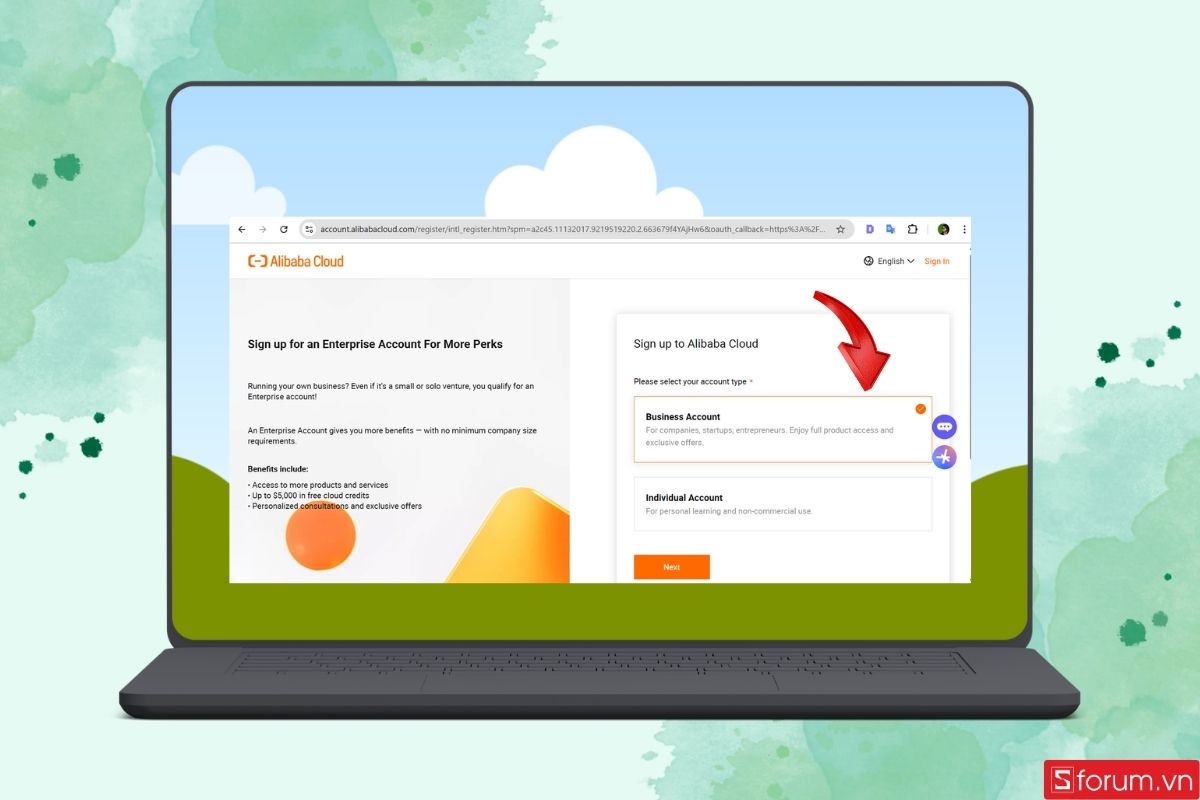

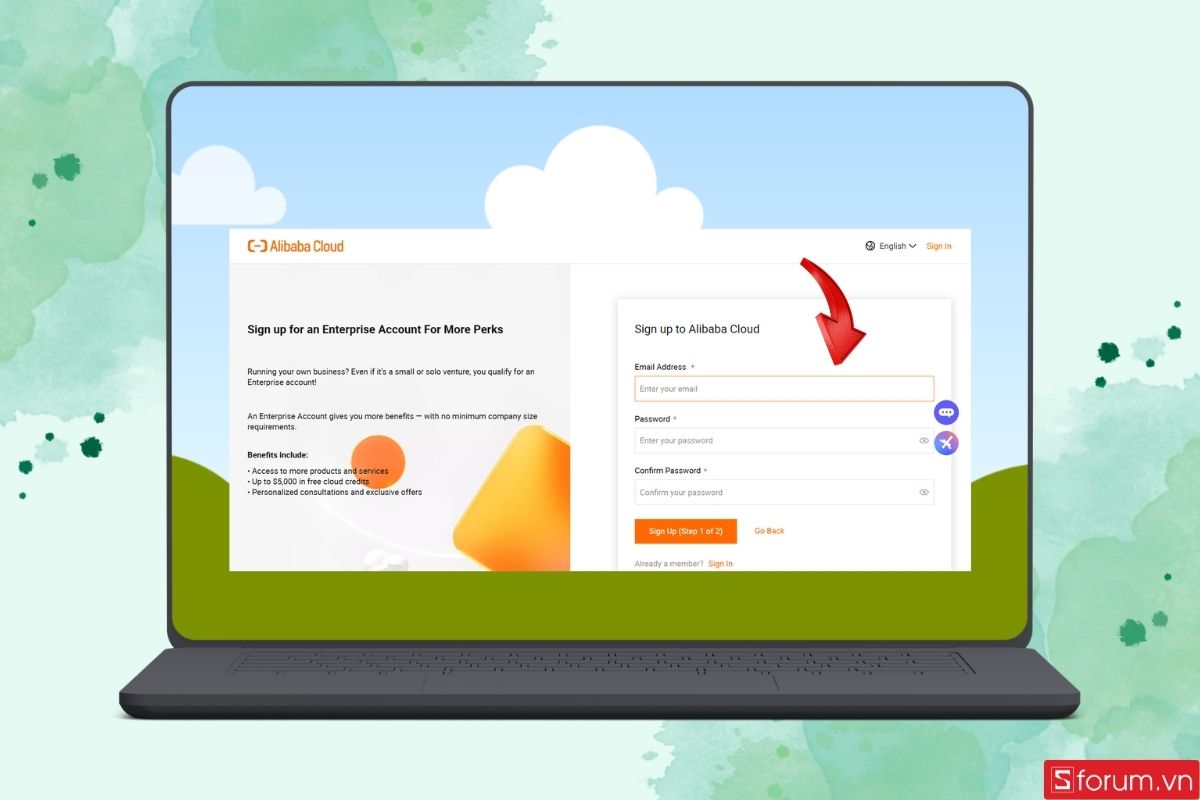

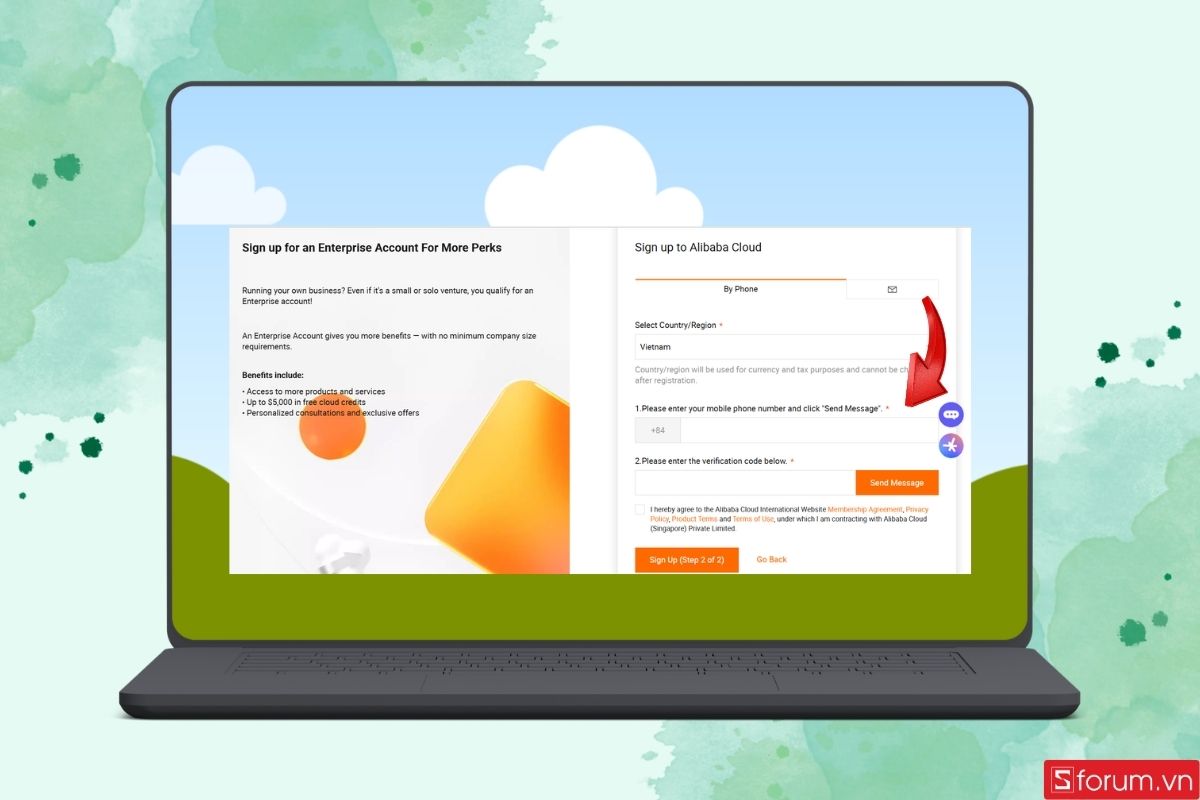

Bước 1: Tạo tài khoản Alibaba Cloud

Bạn cần truy cập vào trang quản trị modelstudio.console.alibabacloud.com và đăng ký bằng email doanh nghiệp. (Lưu ý: Nên cấu hình khu vực ap-southeast-1 để tối ưu độ trễ mạng).

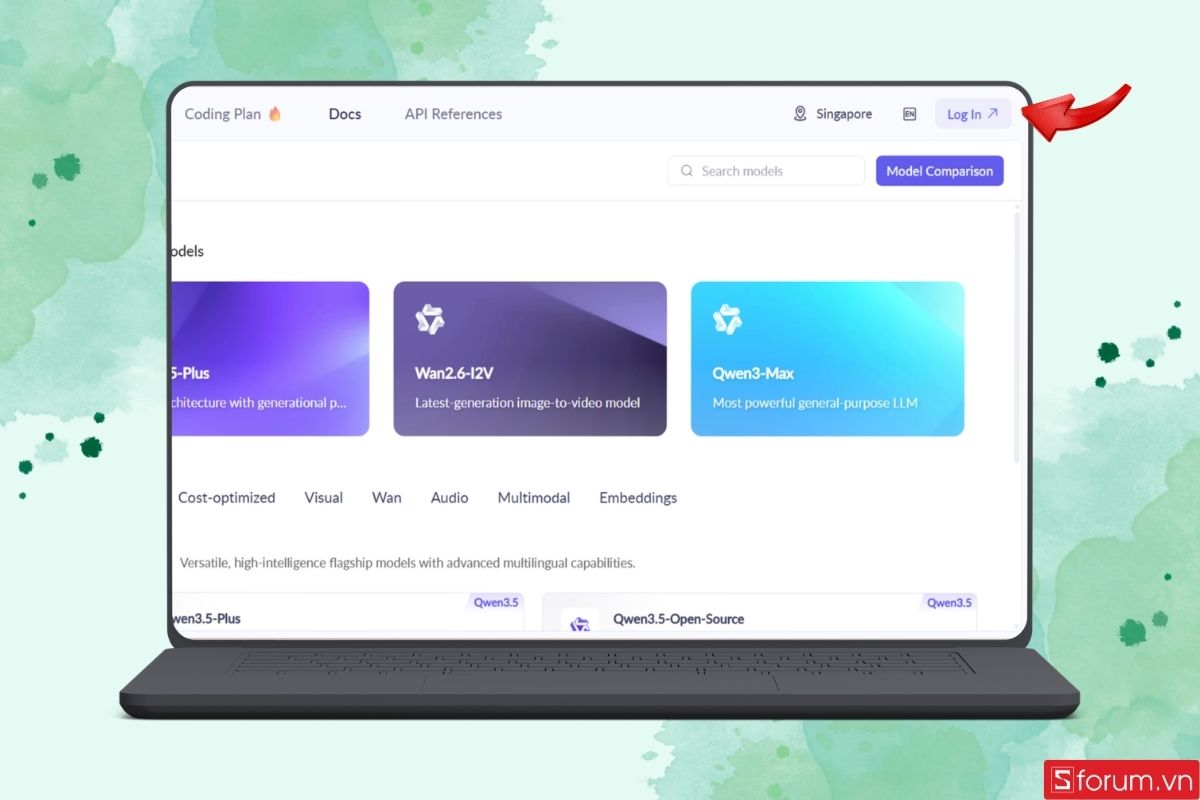

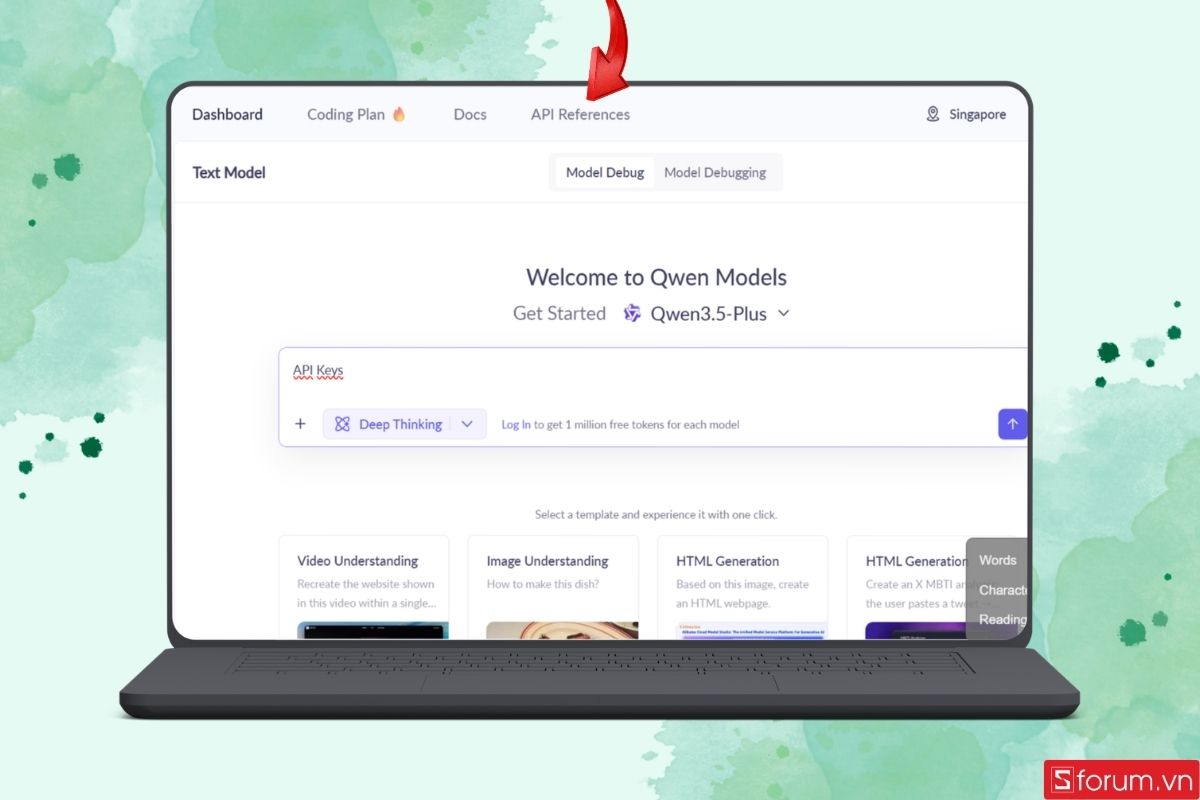

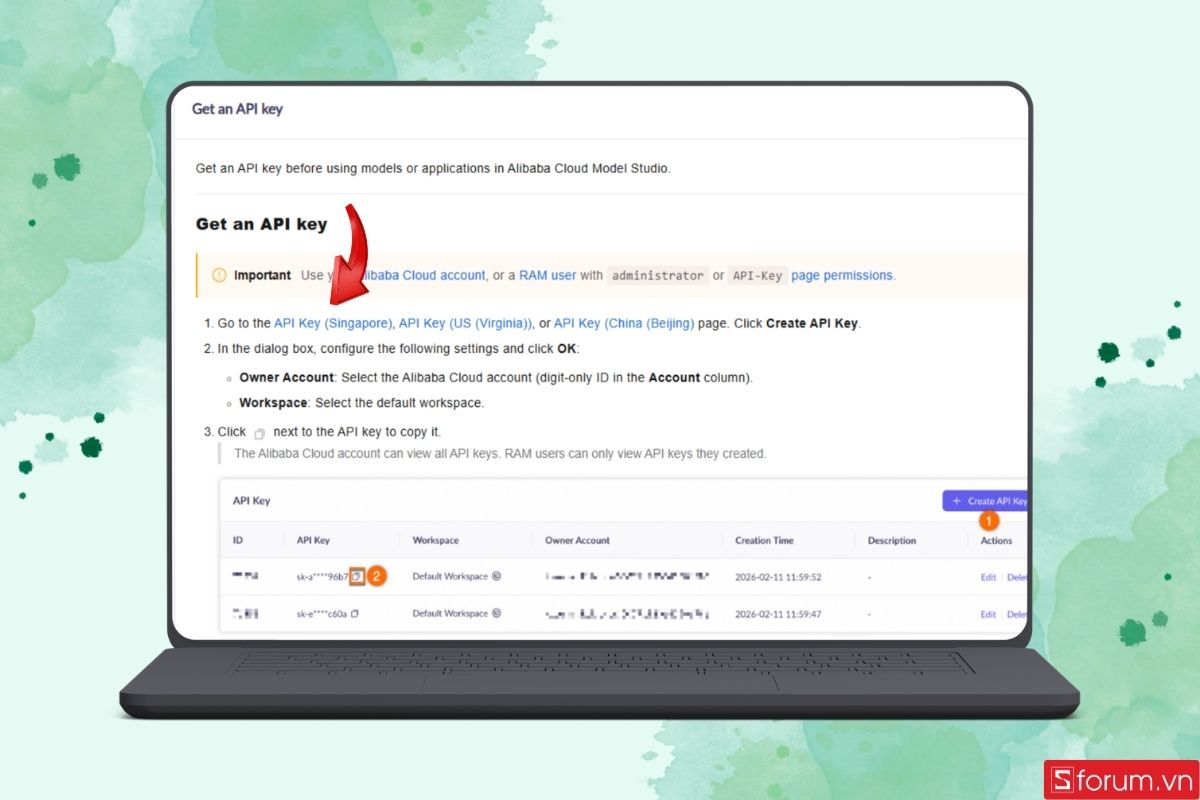

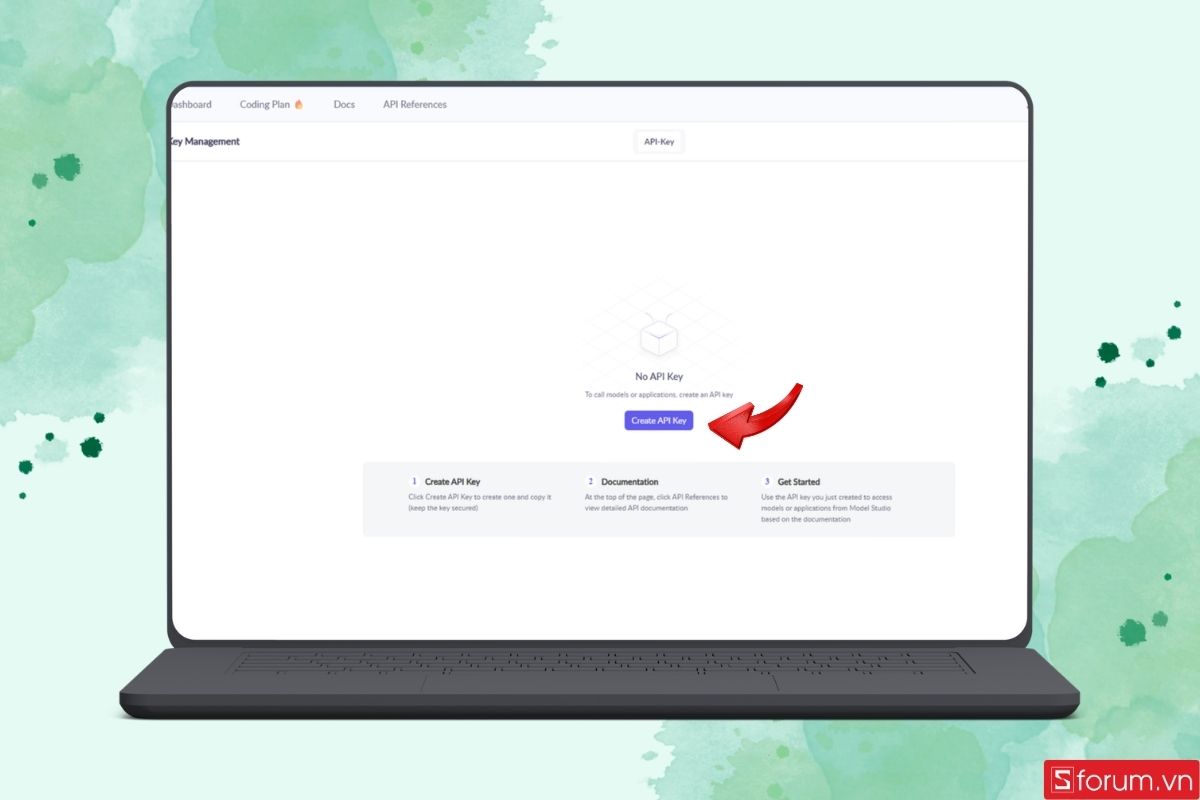

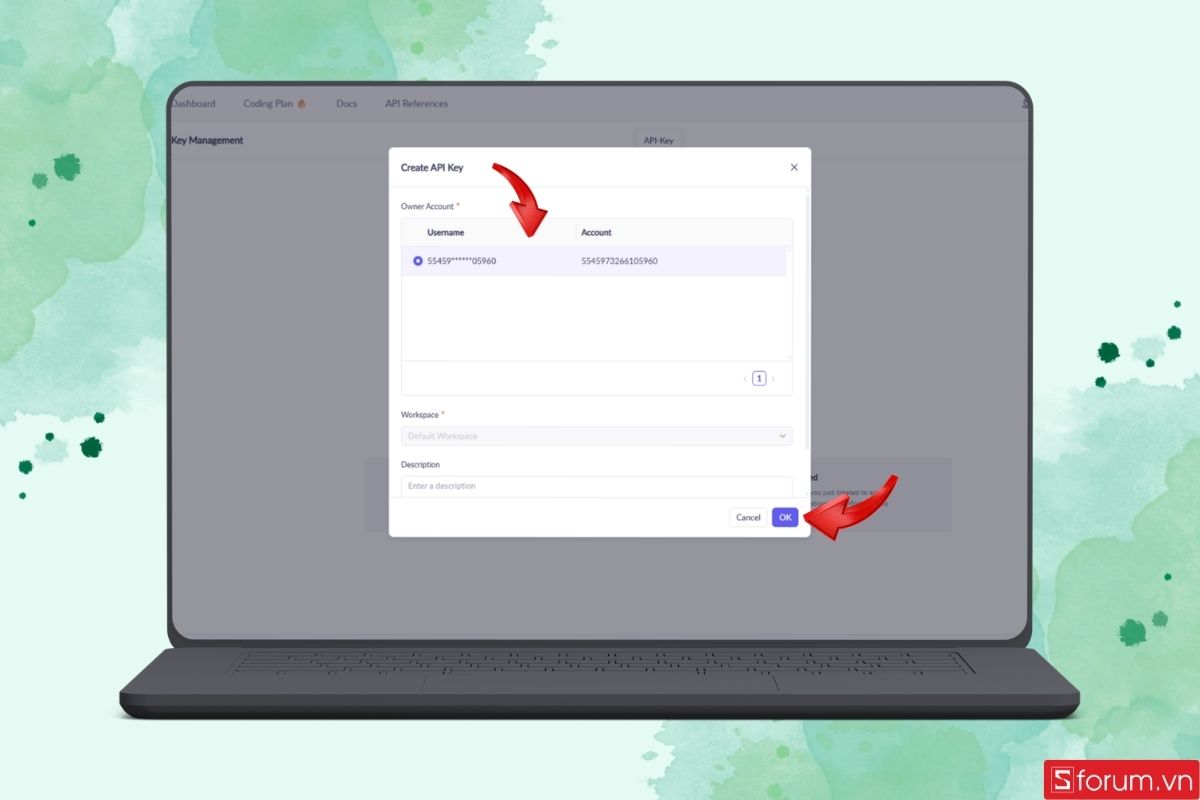

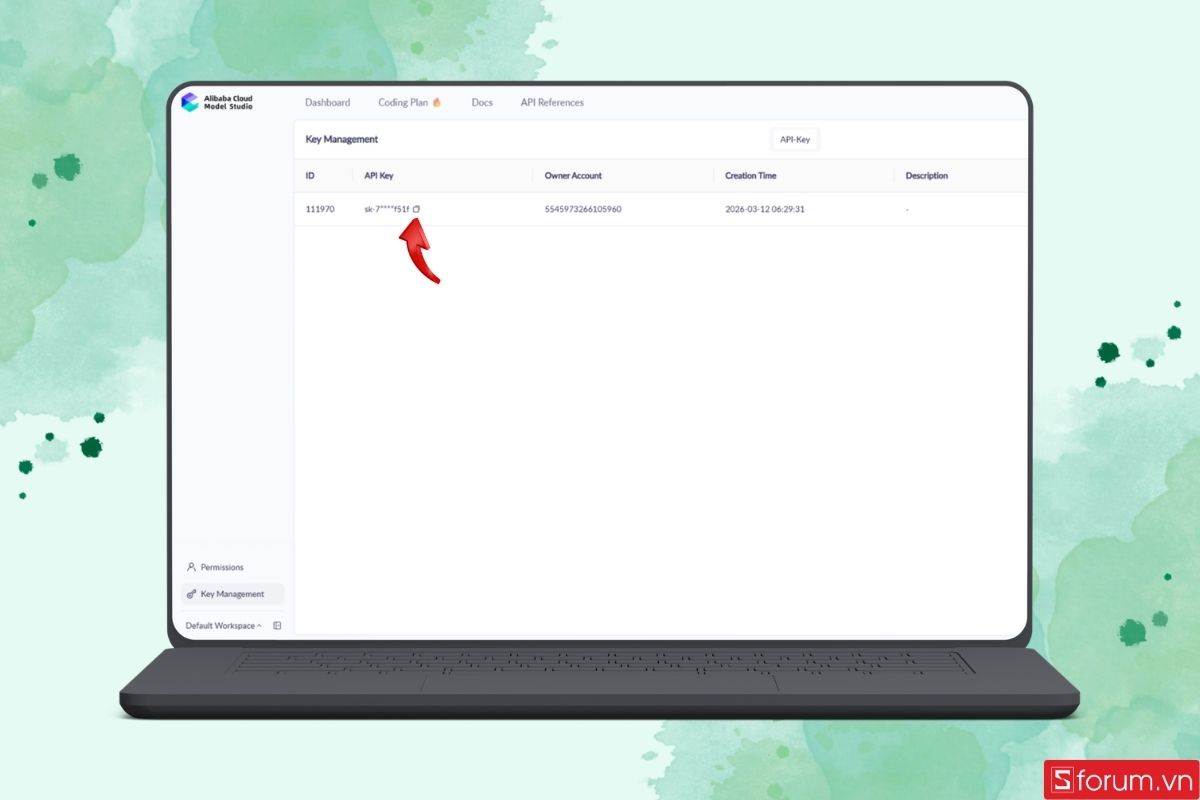

Bước 2: Lấy Khóa API (DASHSCOPE_API_KEY):

Trong bảng điều khiển hệ thống, bạn điều hướng đến mục API References > API Keys > Create AccessKey. Sau đó, bạn copy đoạn mã "DASHSCOPE_API_KEY" và lưu trữ vào trình quản lý bí mật của bạn.

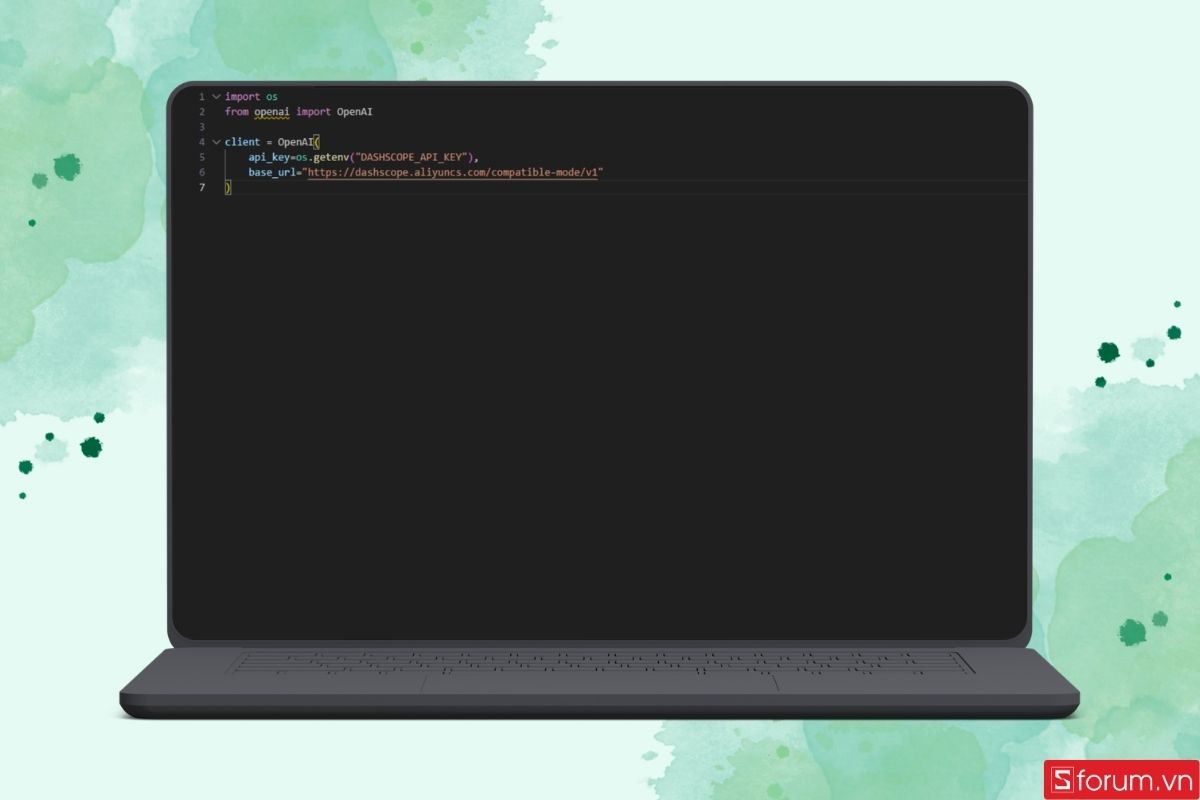

Bước 3: Cấu hình Client tương thích:

Sử dụng thư viện SDK của OpenAI bằng ngôn ngữ Python để kết nối. Bạn thiết lập thông số với URL cơ sở (base_url) trỏ về https://dashscope.aliyuncs.com/compatible-mode/v1.

import os

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"

)

Bước 4: Viết lệnh gọi thực tế:

Bạn có thể khởi tạo các payload dạng văn bản, truyền hình ảnh qua mã hóa Base64 hoặc sử dụng tính năng tool calling.

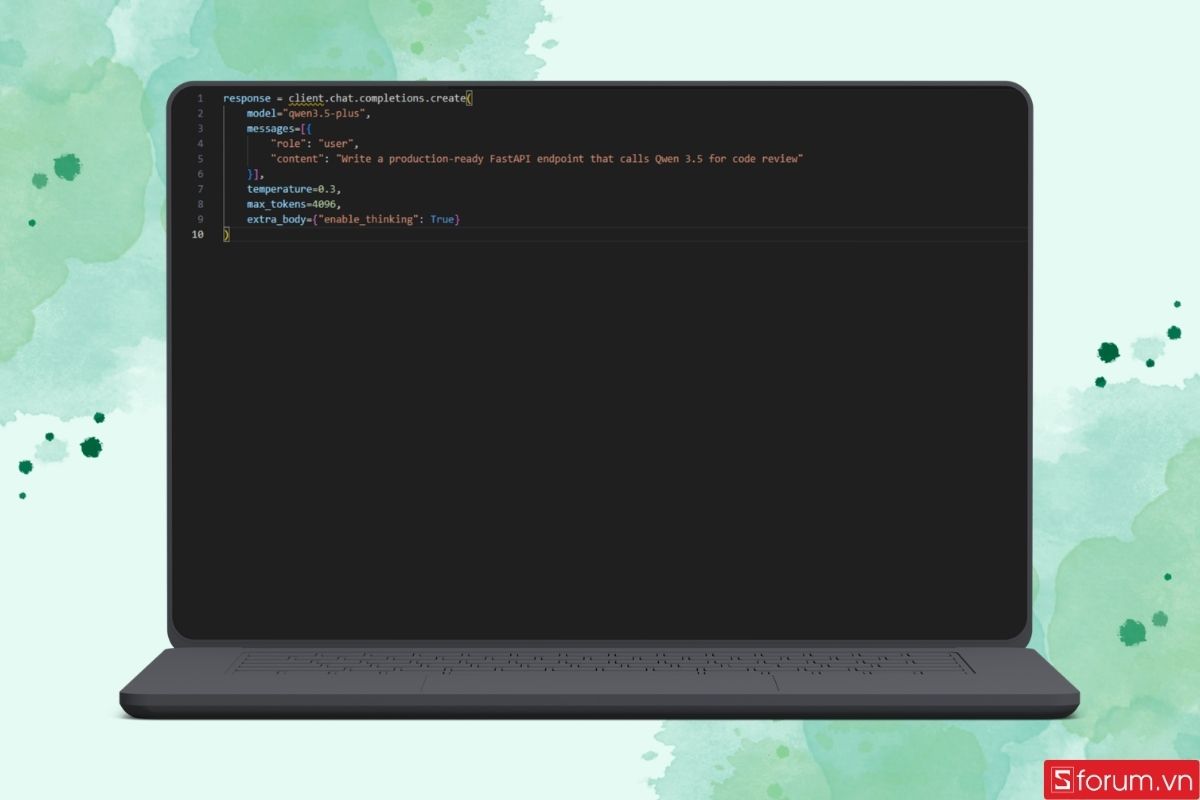

Yêu cầu chỉ văn bản:

response = client.chat.completions.create(

model="qwen3.5-plus",

messages=[{

"role": "user",

"content": "Write a production-ready FastAPI endpoint that calls Qwen 3.5 for code review"

}],

temperature=0.3,

max_tokens=4096,

extra_body={"enable_thinking": True}

)

Yêu cầu Thị giác (Mã hóa Base64):

import base64

def image_to_base64(path):

with open(path, "rb") as f:

return base64.b64encode(f.read()).decode()

image_b64 = image_to_base64("invoice.png")

response = client.chat.completions.create(

model="qwen3.5-plus",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Extract all line items from this invoice and return as JSON"},

{"type": "image_url", "image_url": {"url": f"data:image/png;base64,{image_b64}"}}

]

}]

)

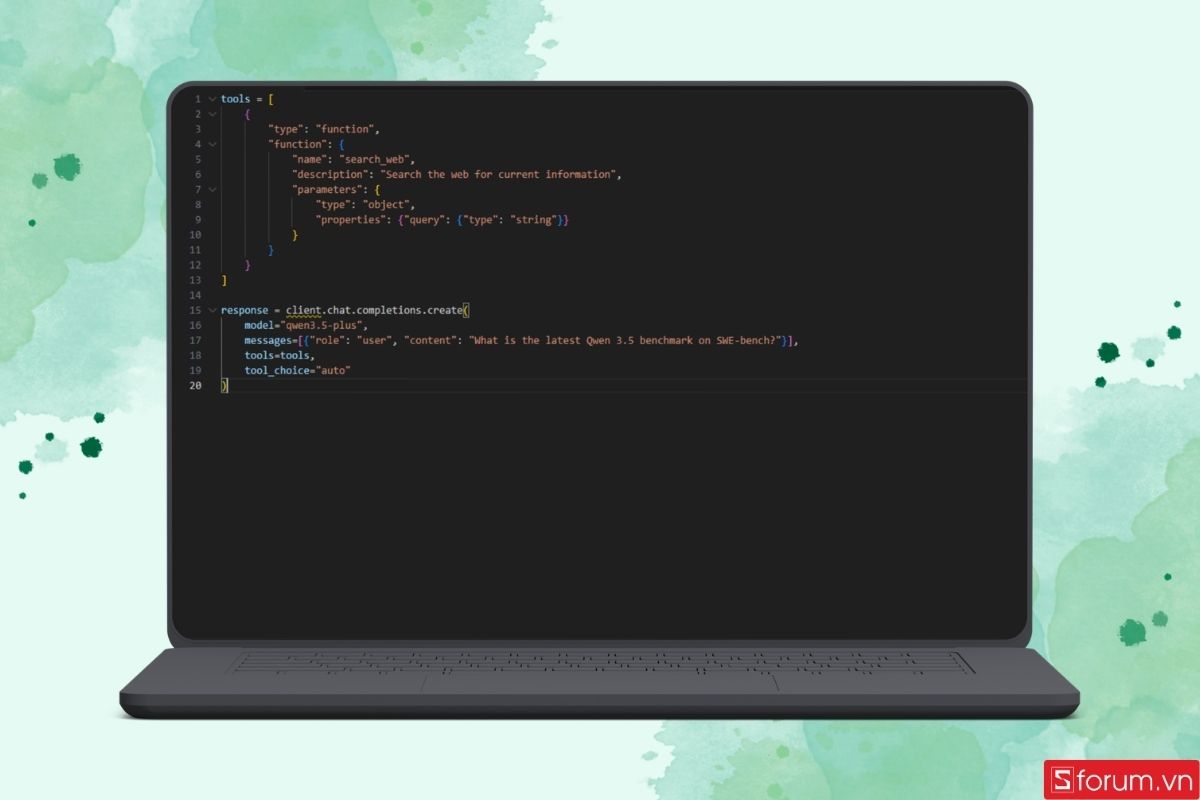

Ví dụ Lệnh gọi Công cụ:

tools = [

{

"type": "function",

"function": {

"name": "search_web",

"description": "Search the web for current information",

"parameters": {

"type": "object",

"properties": {"query": {"type": "string"}}

}

}

}

]

response = client.chat.completions.create(

model="qwen3.5-plus",

messages=[{"role": "user", "content": "What is the latest Qwen 3.5 benchmark on SWE-bench?"}],

tools=tools,

tool_choice="auto"

)

Mẹo nhỏ: Để tiết kiệm một nửa thời gian tích hợp API, các kỹ sư thường tận dụng nền tảng Apidog để tạo tự động các bài kiểm thử và mô phỏng luồng dữ liệu.

Đừng chần chừ, hãy bắt đầu trải nghiệm và xây dựng ứng dụng với Qwen 3.5 ngay hôm nay. Nếu bạn đang tìm kiếm một thiết bị Laptop AI có cấu hình mạnh mẽ để trực tiếp chạy thử và phát triển mô hình AI cục bộ, hãy ghé ngay hệ thống CellphoneS để nhận những ưu đãi tốt nhất nhé!

[Product_Listing categoryid="2197" propertyid="" customlink="https://cellphones.com.vn/laptop/ai.html" title="Danh sách Laptop AI đang được quan tâm nhiều tại CellphoneS"]

Tóm lại, Qwen 3.5 là một bước nhảy vọt của AI mã nguồn mở, mang đến trí tuệ đa phương thức đỉnh cao, vượt qua nhiều điểm benchmark khó nhằn với hiệu suất vận hành chưa từng có. Các doanh nghiệp và nhà phát triển phần mềm nên xem xét nghiêm túc việc chuyển đổi hoặc tích hợp mô hình này vào quy trình làm việc để tối ưu hóa chi phí và nâng cao năng lực cho toàn bộ hệ thống.

Xem thêm:

Câu hỏi thường gặp

Qwen 3.5 có phải trả phí để sử dụng không?

Có và Không. Các biến thể mã nguồn mở của Qwen 3.5 (như bản 397B-A17B) được phát hành theo tiêu chuẩn giấy phép Apache 2.0, cho phép người dùng tự do sử dụng, tinh chỉnh và thương mại hóa mà không tốn phí bản quyền. Riêng các bản API nâng cao lưu trữ trên đám mây (như Qwen3.5-Plus) sẽ tính phí tùy theo khối lượng token tiêu thụ.

Qwen 3.5 có thể giao tiếp bằng bao nhiêu ngôn ngữ?

Hệ thống này sở hữu bộ từ vựng 250k, hỗ trợ đa dạng tới 201 ngôn ngữ và phương ngữ trên toàn cầu (tăng 69% so với thế hệ trước), đặc biệt đọc hiểu rất tốt các ngôn ngữ có nguồn tài nguyên đào tạo thấp.

Tôi có thể chạy Qwen 3.5 trực tiếp trên máy tính cá nhân không?

Hoàn toàn được. Bằng cách sử dụng các phiên bản đã được lượng tử hóa (chẳng hạn như chuẩn định dạng GGUF), bạn có thể vận hành các mô hình AI này ngay trên phần cứng của thiết bị cá nhân một cách nhẹ nhàng mà không bắt buộc phải có kết nối mạng internet.

Hợp nhất sớm (Early Fusion) trong hệ thống này có nghĩa là gì?

Đây là kỹ thuật chuyên sâu đưa trực tiếp luồng dữ liệu hình ảnh hoặc video vào thẳng mạng lưới nơ-ron ngay từ các lớp xử lý đầu tiên, thay vì dùng một bộ chuyển đổi rời rạc. Kỹ thuật này giúp AI hiểu sâu sắc và liên kết chặt chẽ hơn mối quan hệ giữa không gian hình ảnh và văn bản.

Lợi ích cốt lõi của kiến trúc MoE trên mô hình này là gì?

Lợi ích lớn nhất của kiến trúc MoE thưa thớt chính là sự cân bằng hoàn hảo giữa tốc độ và tài nguyên. Nhờ cơ chế chỉ kích hoạt các tham số thực sự cần thiết, mô hình giảm được tới 95% bộ nhớ RAM kích hoạt trong khi vẫn duy trì nguyên vẹn sự nhạy bén và độ thông minh.

.jpg)

Bình luận (0)